В этой статье мы разберём, что такое MLOps, зачем он нужен и как помогает решать реальные проблемы при внедрении моделей машинного обучения в работу. Представим всё на понятных примерах, включая систему обнаружения мошенничества в банке.

Что такое MLOps

MLOps (Machine Learning Operations) — это набор практик и инструментов, которые помогают переносить модели машинного обучения из среды разработки в надёжное промышленное окружение, а затем поддерживать их стабильную и эффективную работу.

Если объяснять проще:

-

MLOps помогает запускать модели в продакшене без ошибок.

-

Следить за их работой.

-

Быстро обновлять модели, когда данные меняются или появляются новые угрозы, например новые виды мошенничества.

Проблема: модель работает в ноутбуке, но ломается в продакшене

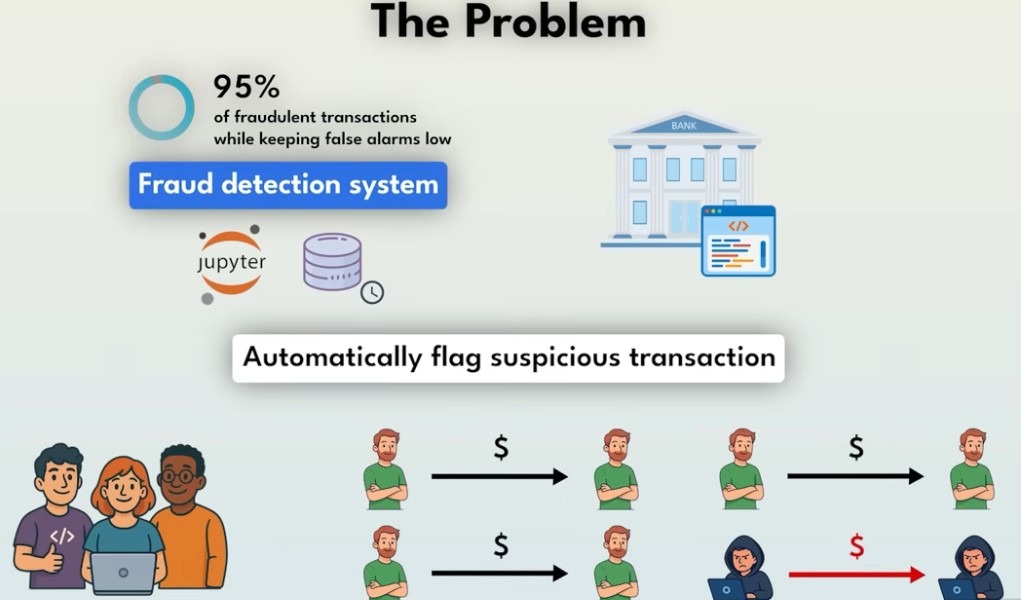

Представьте, что банк создал модель для обнаружения мошенничества.

На ноутбуке дата-учёного она идеально определяет 95% мошеннических операций.

Но после запуска в продакшене всё идёт не так гладко:

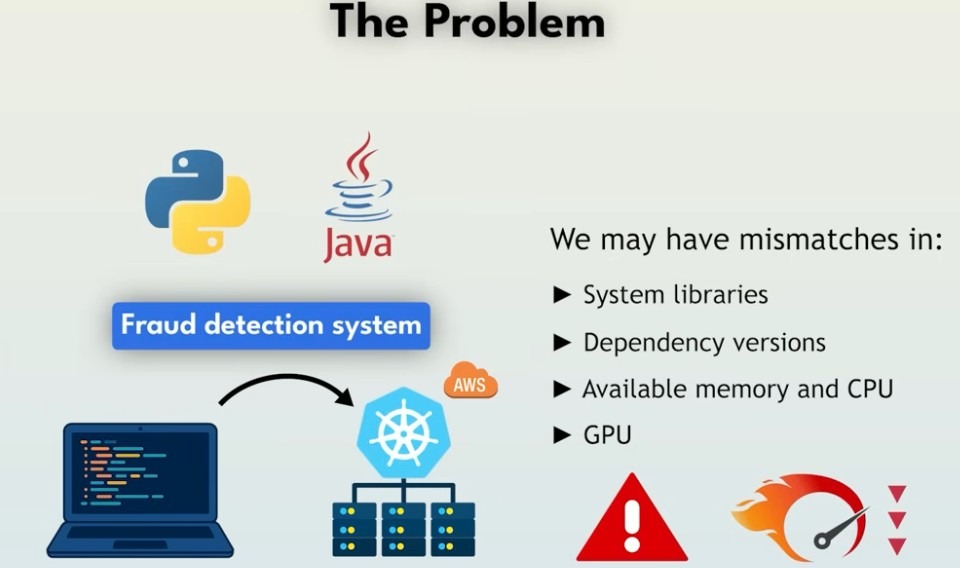

1. Разные языки и библиотеки

Модель была разработана на Python, а продакшен работает на Java, потому что банки используют его для стабильности и безопасности.

Приходится переписывать модель вручную — это медленно и рискованно.

2. Производительность

В ноутбуке модель работает быстро, но в продакшене начинает обрабатывать транзакцию по 3 секунды.

Банку нужны миллисекунды, иначе система просто не успеет проверять тысячи операций в минуту.

3. Несовпадение окружений

На ноутбуке одни версии библиотек, а в AWS-кластере — другие.

Это приводит к ошибкам и непредсказуемому поведению.

4. Деградация качества (data drift)

Через месяц появляются новые виды мошенничества.

Модель их не знает — и начинает пропускать.

5. Отсутствие воспроизводимости

Не записаны данные, параметры, версии.

Невозможно повторить обучение и восстановить работу оригинальной модели.

6. Нет мониторинга

Команда узнаёт о проблеме только после жалоб клиентов.

Как MLOps решает все эти проблемы

1. Консистентное окружение: Docker

Модель упаковывается в контейнер вместе со всеми зависимостями.

Теперь она работает одинаково:

-

на ноутбуке,

-

на сервере разработки,

-

в продакшене.

2. Масштабирование: Kubernetes

Модель разворачивается в Kubernetes (например, Amazon EKS), который:

-

автоматически масштабирует количество экземпляров,

-

перезапускает упавшие контейнеры,

-

обеспечивает стабильность на больших нагрузках.

Конфигурация хранится как infrastructure as code — например, в Terraform.

3. CI/CD для ML

Перед каждым релизом модель проходит:

-

тесты точности,

-

тесты скорости,

-

интеграционные тесты,

-

тесты нагрузки.

Если модель работает слишком медленно, она не будет развернута в продакшен.

4. Отслеживание дрейфа данных

Инструменты вроде:

-

TensorFlow Data Validation,

-

Great Expectations,

проверяют, изменилась ли структура и распределение данных.

Если появляются новые паттерны мошенничества — система отправляет alert.

5. Трекинг экспериментов

Используются MLflow или DVC.

Хранятся:

-

версии данных,

-

параметры модели,

-

метрики,

-

артефакты обучения.

Модель всегда можно пересобрать точно так же.

6. Мониторинг и алертинг

Используются Prometheus и Grafana:

-

точность модели,

-

скорость обработки транзакций,

-

количество ложных срабатываний,

-

ошибки.

Если метрики ухудшаются — отправляется уведомление.

7. Быстрые обновления моделей

С помощью Argo CD, GitHub Actions или GitLab CI:

-

обновление модели происходит без остановки сервиса,

-

можно откатить на предыдущую версию,

-

можно выпускать модели автоматически.

Пример полного MLOps-процесса

-

Data Engineers собирают и очищают данные (Airflow, Kubeflow).

-

Data Scientists обучают модели в Docker-контейнерах.

-

CI/CD запускает тесты на точность и производительность.

-

Модель разворачивается на staging-окружении в Kubernetes.

-

Если всё хорошо — обновляется продакшен.

-

Monitoring постоянно следит за качеством.

-

При дрейфе данных запускается обновление или retraining.

Кому нужен MLOps

✔ Data Scientists

Чтобы их модели реально работали, а не оставались в ноутбуке.

✔ DevOps Engineers

Почти все навыки уже есть — нужно только добавить ML-специфику.

✔ Engineering Managers

Чтобы правильно оценивать сложность и стоимость ML-проектов.

✔ Cloud Engineers

ML требует:

-

GPU,

-

высокопроизводительного хранилища,

-

сетей с высокой пропускной способностью.

Понимание ML делает облачных инженеров значительно ценнее.

Итог

MLOps — это мост между экспериментами в ноутбуке и реальными промышленными системами.

Он делает модели:

-

воспроизводимыми,

-

надёжными,

-

быстрыми,

-

простыми в обновлении.

И если вы работаете в Data Science, DevOps, Cloud или управляете ML-командами, владение MLOps становится обязательным и очень ценным навыком.